Come i Visualization Studios possono iniziare a utilizzare l'IA nel 2026

10 gen 2026

Nel 2026, la domanda per gli studi di visualizzazione non è più "dovremmo usare AI," ma "come lo integriamo senza interrompere la nostra pipeline esistente." La fase sperimentale è passata. Ora siamo in un periodo di stabilizzazione, in cui gli strumenti AI sono abbastanza affidabili per rispettare le scadenze commerciali e abbastanza prevedibili per i contratti con i clienti.

Questa guida delinea punti di ingresso pratici per gli studi che vogliono adottare l'AI in maniera strategica. Si concentra su aree ad alto impatto dove l'automazione riduce gli attriti, permettendo agli artisti senior di concentrarsi sulla direzione artistica piuttosto che sui problemi tecnici.

1/ Concetto e Pre-visualizzazione

Generatori da Testo a Immagine

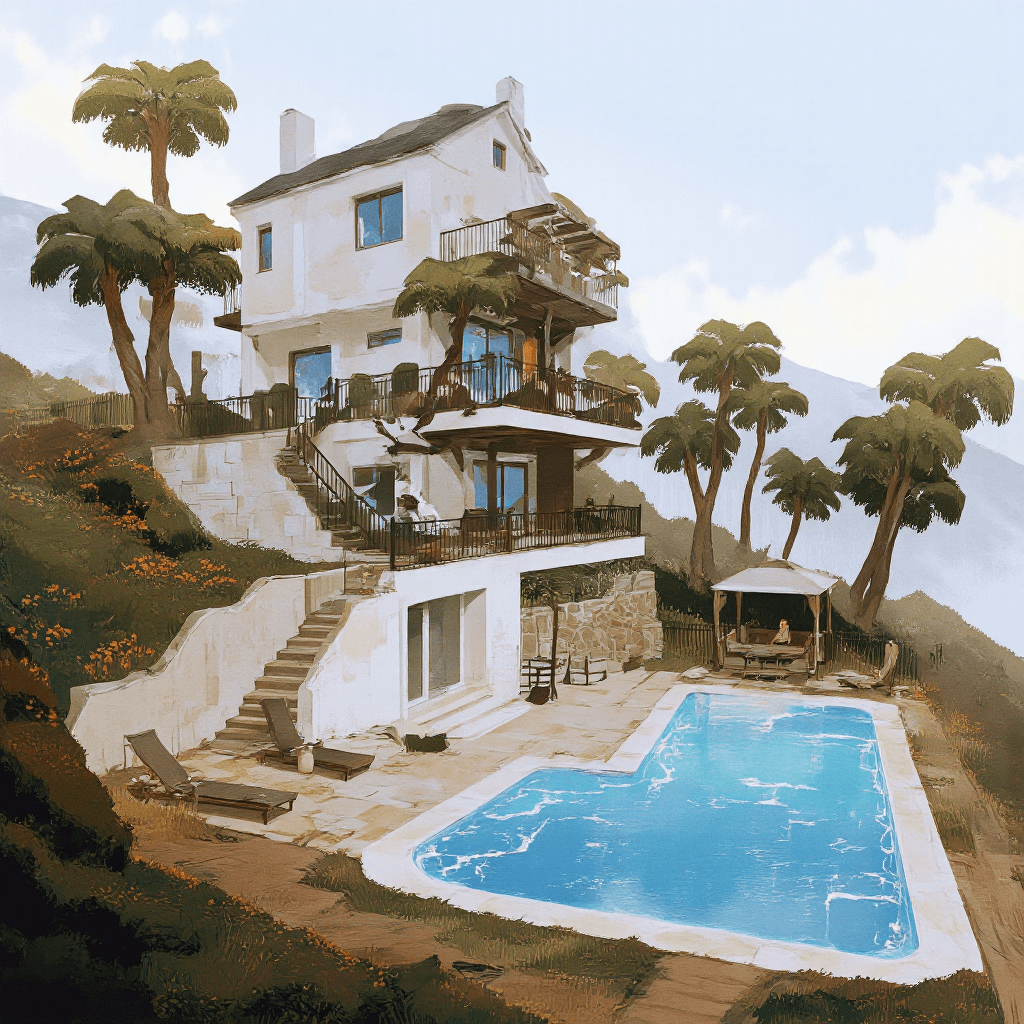

Questi strumenti generano immagini 2D ad alta fedeltà da descrizioni scritte o immagini di riferimento.

Perché è importante: Disaccoppia la fase di "umore" dalla fase di modellazione 3D. Gli studi possono ottenere l'approvazione del cliente su illuminazione, atmosfera e composizione prima che venga modellato anche un solo poligono.

Meglio per: Mood board iniziali e stabilire un linguaggio visivo con il cliente.

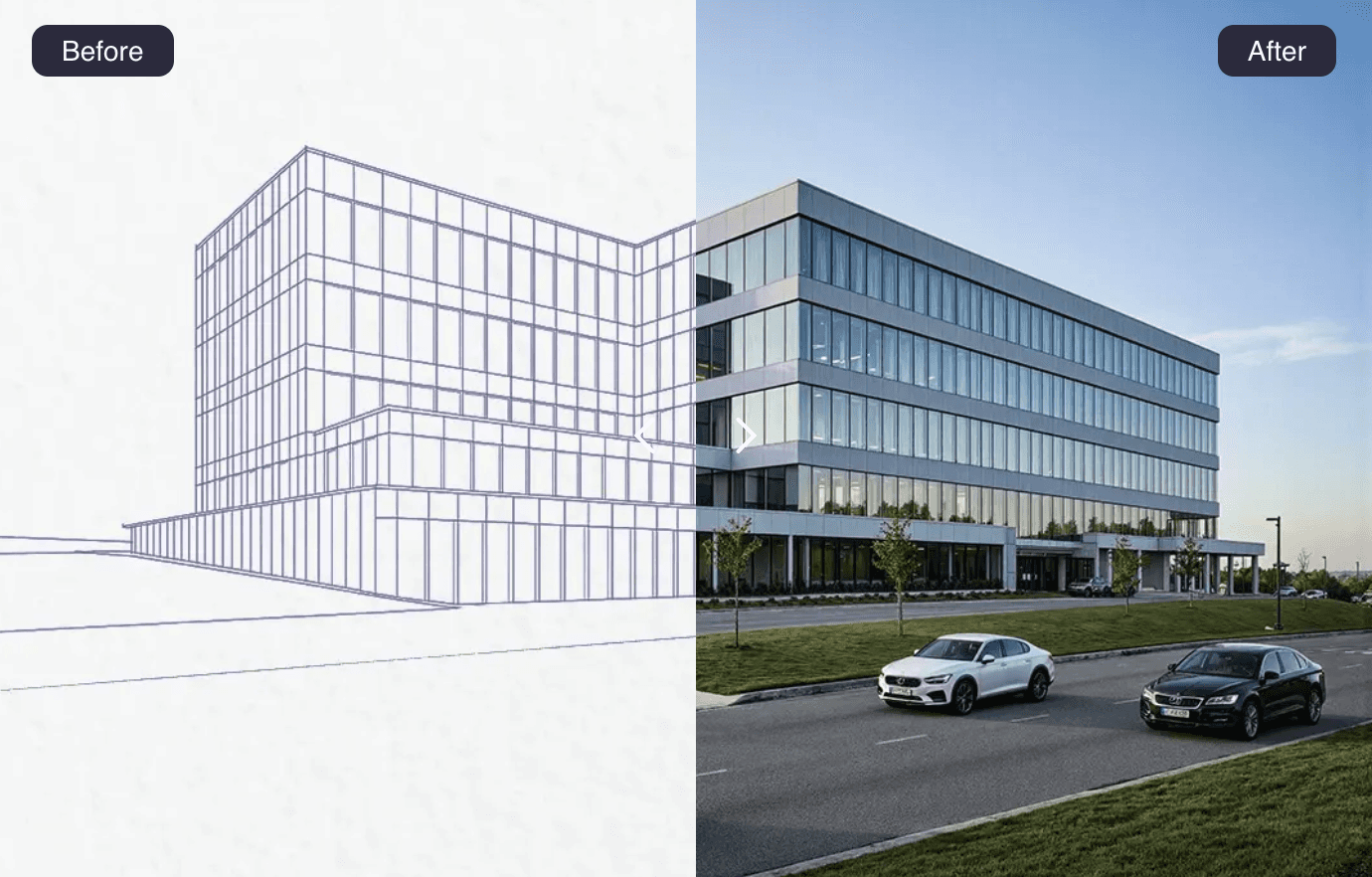

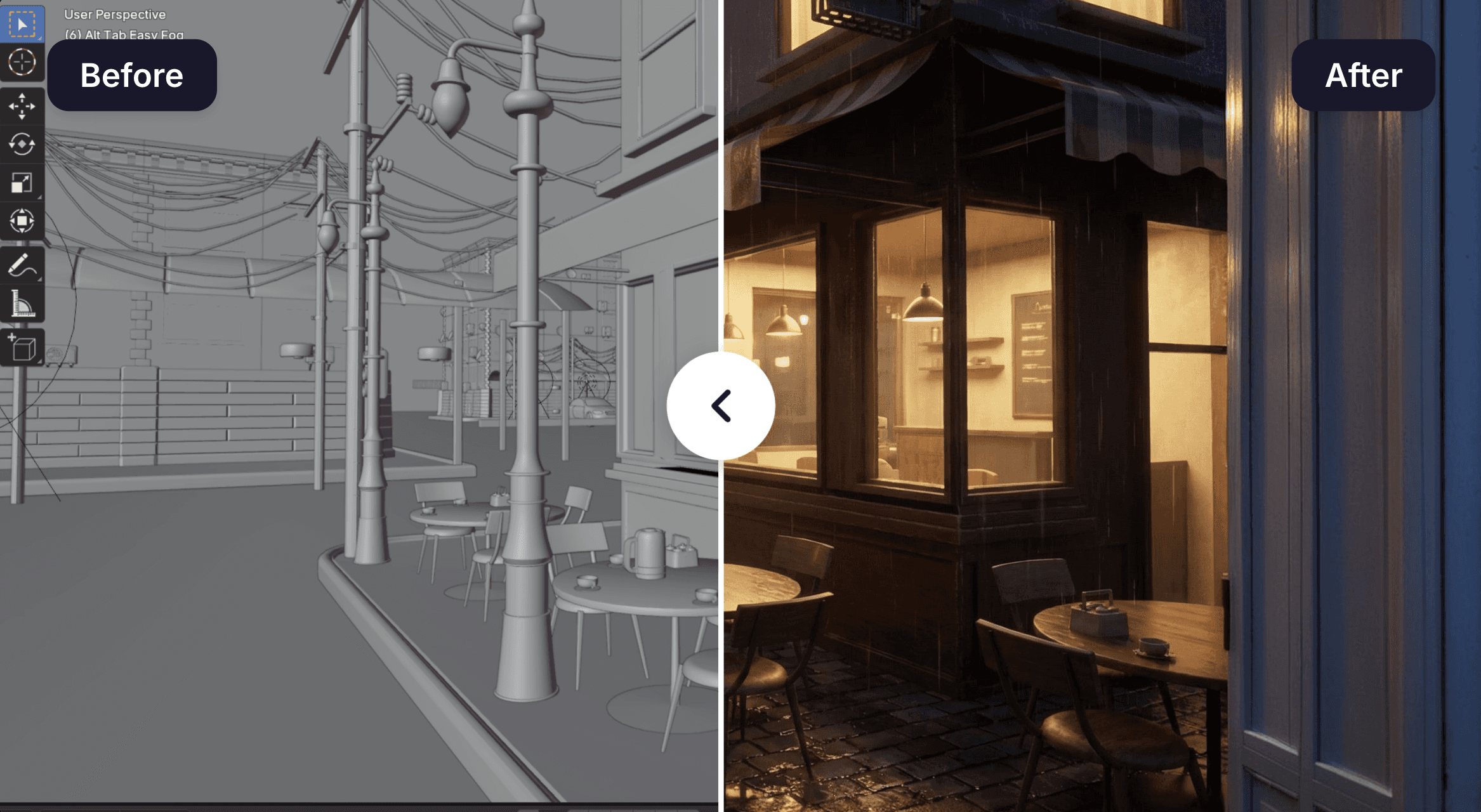

Interpretazione Bozza a Render

Questo approccio prende un blocco o uno schizzo a mano grezzo e proietta su di esso texture e illuminazioni realistiche, rispettando la geometria originale.

Perché è importante: Colma il divario tra un'idea vaga e un'immagine visiva raffinata istantaneamente. Gli architetti possono vedere i loro modelli massivi "vestiti" in pochi secondi, riducendo l'ansia del foglio bianco.

Meglio per: Iterazione rapida durante le riunioni di sviluppo progettuale.

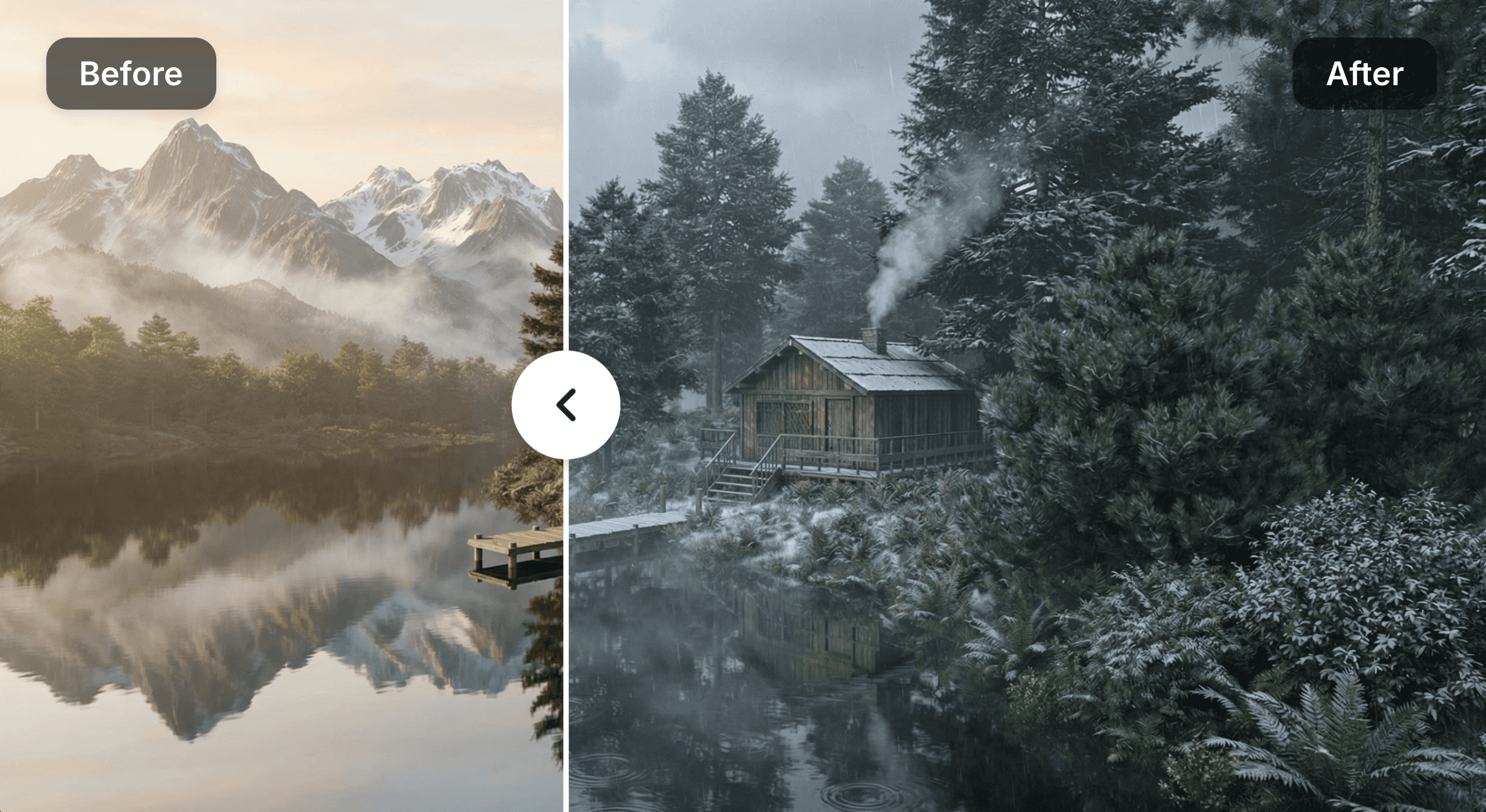

Modelli di Trasferimento Stile

Questi applicano la firma visiva di un artista specifico o un'immagine di riferimento a un nuovo render.

Perché è importante: Permette agli studi di mantenere uno stile "di casa" coerente attraverso diversi progetti o artisti senza post-elaborazione manuale per ogni fotogramma.

Meglio per: Garantire la coerenza nei progetti di grandi team.

2/ Produzione di Asset e Ambiente

Generazione di Texture AI

Strumenti che creano mappe PBR (Physically Based Rendering) senza interruzioni e ad alta risoluzione, diffuse, normali, di ruvidità e di spostamento, da prompt di testo o foto campione.

Perché è importante: Trovare la texture perfetta spesso richiede più tempo che applicarla. L'AI genera materiali su misura istantaneamente, eliminando la necessità di cercare nelle librerie "cemento con leggero muschio".

Meglio per: Creare materiali personalizzati che corrispondono a riferimenti specifici del cliente.

Generazione di Oggetti 3D da Testo

Modelli generativi che creano geometrie mesh e texture per oggetti di sfondo basati su descrizioni.

Perché è importante: I modellatori dedicano troppo tempo su asset non eroici come mobili, piante o disordine. Automatizzare questo li libera per concentrarsi sull'architettura stessa.

Meglio per: Popolare scene con asset di contesto unici (vasi, libri, arredi urbani).

Generatori di Skybox per Ambienti

Questi generano mappe HDRi (Immagini ad Alto Raggio Dinamico) a 360 gradi per l'illuminazione e i riflessi di sfondo.

Perché è importante: Le librerie HDRi standard sono troppo usate. Gli ambienti di illuminazione personalizzati assicurano che il render non sembri "quel famoso cielo stock".

Meglio per: Creare scenari di illuminazione unici per scatti esterni.

3/ Rendering e Post-Produzione

Upscaling e Denoising AI

Algoritmi che prendono un render grezzo a bassa risoluzione, rumoroso e lo ingrandiscono intelligentemente a 4K o 8K eliminando il granello.

Perché è importante: Cambia radicalmente l'economia del rendering. Gli studi possono rendere con campioni inferiori a risoluzioni più basse, riducendo i costi del render farm del 50-70%, e usare l'AI per colmare il divario qualitativo.

Meglio per: Scadenze strette dove re-rendering a piena qualità è impossibile.

Inpainting Generativo

La capacità di selezionare un'area specifica di un render (come una finestra o un'auto) e sostituirla con contenuti generati che corrispondono alla prospettiva e all'illuminazione.

Perché è importante: Risolve il problema del "99% completo". Se un cliente vuole cambiare una maniglia della porta o rimuovere un albero, non è necessario re-renderizzare la scena. Si corregge in post.

Meglio per: Richieste dell'ultimo minuto del cliente e correzione di glitch 3D.

Relighting Basato su Depth-Map

Strumenti che utilizzano le informazioni di profondità di un render 3D per consentire regolazioni di illuminazione post-render.

Perché è importante: Offre flessibilità dopo che il render è finito. È possibile spostare l'angolo o l'intensità del sole senza riaprire il software 3D.

Meglio per: Affinare l'umore durante la fase finale di compositing.

4/ Amministrativo e Pipeline

Tagging Automatico degli Asset

Sistemi che analizzano le librerie di modelli 3D e assegnano automaticamente tag (es. "Sedia," "Moderno," "Legno," "Alta-Poligonazione").

Perché è importante: La maggior parte degli studi ha terabyte di asset che sono impossibili da cercare. L'AI organizza questo "deposito di rottami digitali" in una libreria utilizzabile.

Meglio per: Ripulire i dati legacy del server.

Trascrizione e Sintesi delle Riunioni

Agenti AI che registrano le chiamate con i clienti ed estraggono requisiti di design specifici ed elementi di azione.

Perché è importante: Protegge lo studio dal creep dell'ambito. Avere un record neutrale e ricercabile di esattamente ciò che il cliente ha richiesto previene dispute da "Pensavo che avessimo concordato su...".

Meglio per: Briefing del cliente e sessioni di feedback.

5/ Collaborazione con i Clienti

Assistenti di Visualizzazione in Tempo Reale

Strumenti che funzionano insieme al software 3D per generare render "anteprima" in tempo reale mentre l'artista lavora.

Perché è importante: Riduce il ciclo di feedback. I clienti possono vedere un look "quasi finale" durante una sessione di lavoro, invece di aspettare una settimana per un render di prova.

Meglio per: Revisioni di design interattive.

Generazione di Video da Immagini

Modelli che prendono un render statico e generano un breve movimento della macchina da presa o un'animazione ambientale (vento, acqua).

Perché è importante: I video comandano tariffe più elevate delle immagini statiche. L'AI permette agli studi di upsell delle "immagini viventi" senza l'enorme sovraccarico di un rendering completo di animazioni.

Meglio per: Materiali di marketing sui social media per sviluppi immobiliari.

Comincia in piccolo, ma comincia standard

> “Non abbiamo bisogno di AI per fare tutto. Abbiamo solo bisogno che risolva il collo di bottiglia.”

Gli studi di maggior successo nel 2026 non stanno cercando di automatizzare l'intero processo creativo. Stanno identificando la parte più lenta del loro flusso di lavoro, solitamente la texturizzazione o il rendering, e applicano uno strumento AI specifico per risolverlo.

Inizia testando uno strumento per un compito specifico. Una volta che quello strumento dimostra di risparmiare tempo senza abbassare la qualità, rendilo una parte standard del manuale. Poi, passa al prossimo collo di bottiglia.

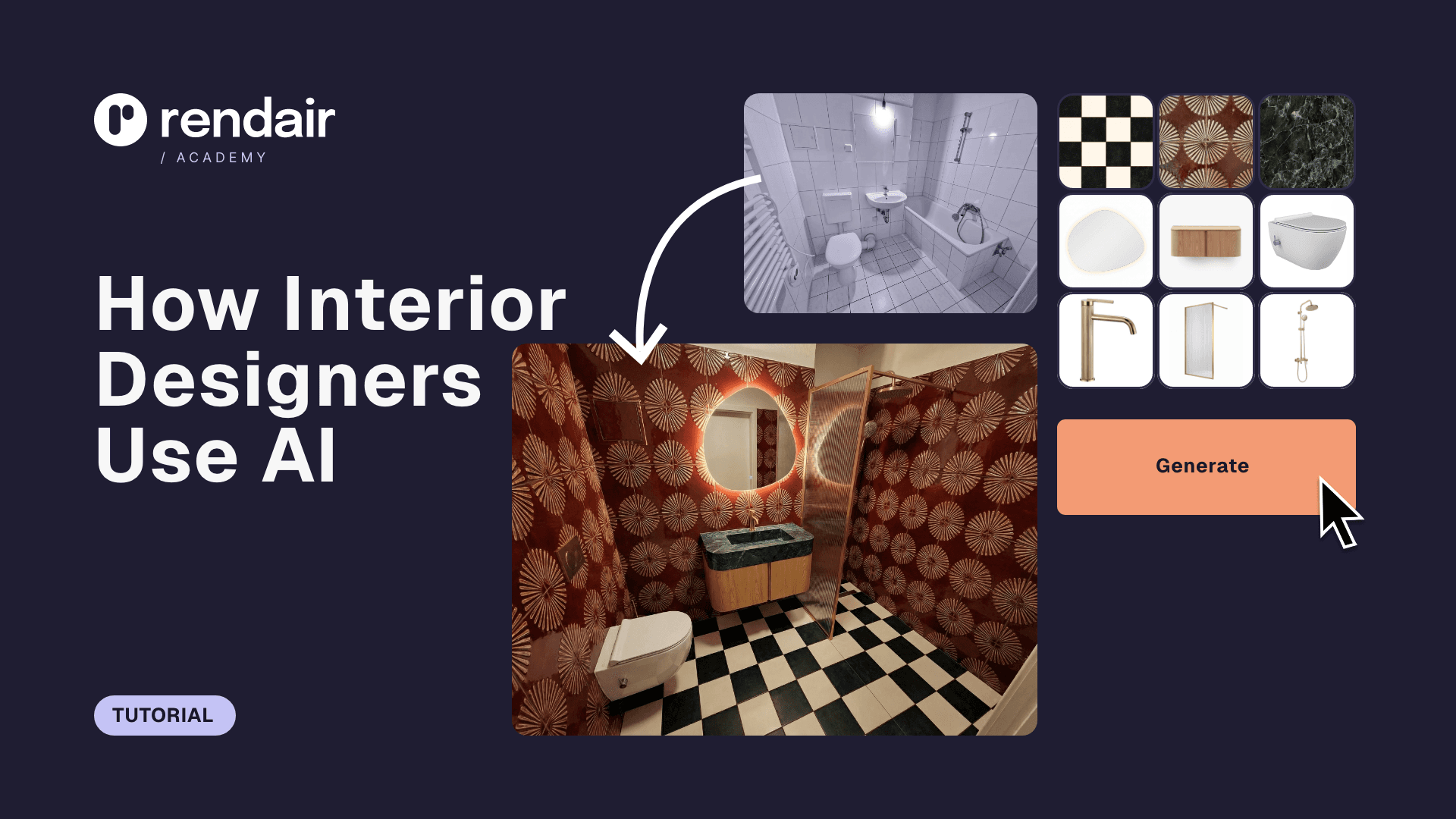

Bonus: Il flusso di lavoro unificato

La maggior parte degli studi lotta perché gestiscono sei diverse sottoscrizioni AI.

Rendair AI consolida queste capacità in uno spazio di lavoro unico. Invece di esportare in uno strumento per l'upscaling, un altro per l'inpainting e un terzo per il video, è possibile gestire l'intero ciclo di visualizzazione in un unico posto. È progettato per adattarsi ai flussi di lavoro professionali, offrendo il controllo di cui gli studi hanno bisogno con la velocità che i clienti si aspettano.

Post recenti

Unisciti a oltre 500.000 architetti che hanno risparmiato tempo. Non è necessaria una carta di credito per i tuoi primi 20 crediti.